熱門資訊> 正文

MiniMax成Token調用第一之后,模型廠商的下一個必爭高地顯現

2026-02-27 09:52

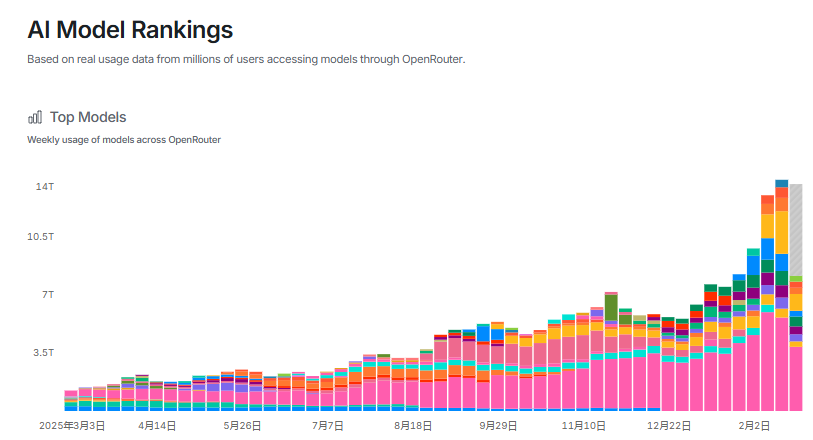

最近,大模型token調用量井噴成為關注點。OpenRouter最新數據顯示,各大模型的token調用量自2026年1月下旬出現明顯躍升。

與此同時,國產大模型站上舞臺中央。2月9日-15日這周,中國模型以4.12萬億token的調用量,首次超過同期美國模型的2.94萬億token。16日-22日這周,中國模型的周調用量進一步衝高至5.16萬億Token,三周大漲127%,而同期美國模型調用量跌至2.7萬億Token。平臺調用量排名前五的模型中,有四款來自中國廠商,分別為MiniMax的M2.5、月之暗面的Kimi K2.5、智譜的GLM-5以及DeepSeek的V3.2。這四款模型合計貢獻了Top5總調用量的85.7%。

其中,M2.5一鳴驚人,在發佈后12小時內登頂OpenRouter熱度榜,一周內登頂調用量榜首,周調用量暴漲至3.07T tokens,超過Kimi K2.5、GLM-5與DeepSeek V3.2三家的總和。

OpenRouter是全球最大的大模型API聚合平臺,可為開發者提供統一API接口,以訪問全球數百種大語言模型。其核心功能包括多模型調用、智能路由優化和透明的性能排行榜,旨在解決多模型集成複雜和廠商封鎖問題。

當目光聚焦於AI應用普及、國產模型崛起等,不應該忽視數據背后的結構性變化。

模型調用量因何在近期爆發?排名靠前的為何是M2.5等新秀?

多家機構認為,一方面是,春節帶來AI應用滲透率提高,token消耗量有了總體提升;另一方面,AI模型的Agent(智能體)場景廣泛落地,單次任務token消耗大幅增加。

伴隨1月下旬以來的這一輪增長,梳理AI行業的新動向,也能為上述問題提供思路。

首先是OpenClaw爆火,這是一個能讓大模型獲得本地操作系統權限的開源智能體框架,可讓AI可以自己執行Shell命令、操作文件系統,實現所謂的「本地代理主權」。當地時間2月15日,OpenClaw的創造者Peter Steinberger正式加入OpenAI,負責推動「下一代個人智能體」的研發。

隨后多個面向智能體場景的大模型發佈,反響熱烈——

稀宇科技(MiniMax)於2月13日發佈MiniMax M2.5,稱該模型為全球首個為智能體場景原生設計的生產級旗艦模型。其發佈后七天的調用量即突破3.07T tokens,憑藉在編程和Agent工作流中的卓越性能與極低的成本,成為開發者首選。

月之暗面(Moonshot AI)於1月27日發佈KimiK2.5,該模型採用原生多模態架構,能通過調度多達100個「Agent分身」並行工作,將複雜任務效率提升3到10倍。該模型在多個細分榜單(如編程、工具調用)中均排名第一,其調用量遠超Gemini 3和Claude模型。

智譜於2月12日發佈GLM-5,該模型參數規模進一步擴展,採用了稀疏注意力機制,是其專為複雜系統工程與長程Agent任務設計的旗艦模型。憑藉免費、200K上下文窗口等優勢,該模型發佈后用户迎來高速增長,智譜對Coding Plan先后進行了限售、漲價等動作。

這些模型聚焦於提升編程能力和智能體任務的自動化水平,這兩大能力讓AI的應用場景從私人化娛樂向生產環境轉變,專業開發者的token消耗遠比普通對話密集,這類需求一旦被激活,帶動的調用增量隨之大幅攀升。

OpenRouter的官方數據證實了這一點,該平臺超70%的token消耗量,來自互聯網大廠、中大型企業、專業開發者的生產環境常態化調用,這類場景的單次token調用量遠超個人用戶、小型測試項目等。官方確認,過去數周內,平臺長文本生成需求顯著上升,在100K至1M token區間,MiniMax M2.5的調用量處於領先位置,這個區間正是智能體工作流的典型消耗場景。

可以説,這輪token消耗量爆發,直接反映出大模型發展的新趨勢,AI正從「快思考」走向「慢思考」、從「工具」走向「勞動力」,各大AI前沿公司力研的智能體功能正屬於「慢思考」的範疇。

當模型面對複雜任務(如「寫一個電商網站的代碼」)時,它不再直接輸出答案。它會先「自言自語」:拆解需求、設計架構、編寫函數、檢查bug、優化性能,因為AI開始「在腦子里反覆推演」。每一次推演、每一步邏輯鏈的建立,都在消耗token。這種「推理密度」的增加,使得token消耗的增長速度遠遠超過了用户數量或提問次數的增長速度。

中信證券稱,AI應用場景從簡單對話,向多模態(文本/圖像/音頻/視頻)、AI智能體升級,單次任務token消耗呈指數級上升。該機構認為,token的爆發式增長,本質上反映出AI推理需求的指數級擴容。

華泰證券此前預測,隨着推理範式變化,智能體加速落地,未來算力需求中存在兩個倍數關係,共同決定了算力需求的廣闊空間:

1)推理和token調用量之間不是線性關係,這是因為多智能體協作和多工具調用會帶來token消耗量加速增長;

2)算力需求與token的增長之間不是線性關係,這是因為隨着推理過程更加複雜,同樣算力條件下計算時間也將增長,實時性和交互性帶來對計算速度的要求。

該機構認為,與Chatbot相比,智能體在執行任務時會進行任務的分解與編碼,將帶來交互次數、任務複雜度、使用頻率的提升,整體token消耗或提升十倍以上,而對應的算力需求將增長百倍以上,長期看好算力需求的持續快速增長。

推薦文章

美股機會日報 | 伊朗稱高濃縮鈾不得運往國外;特朗普再出手!美國政府20億美元佈局量子計算;SpaceX正式遞表衝刺納斯達克

一圖看懂 | 連續兩季盈利!蔚來Q1經營利潤0.66億元,交付量超8萬輛;毛利率創近四年新高

SpaceX更多IPO細節披露:去年虧損49億美元,馬斯克掌握85%投票權,股票分階段解禁

英偉達上調股息,市場投資者擔憂其未來增長前景

伊朗戰事引發市場集體焦慮!美財長發話:收益率與通脹上升是 「暫時的」

美國聯邦航空管理局:SpaceX計劃五年內實現每年10000次發射

SpaceX IPO招股書首度曝光:星鏈年賺113億美元,航天業務虧損,估值劍指1.8萬億美元!

5月21日外盤頭條:特朗普稱處理伊朗問題進入最后階段 英偉達Q1營收同比大增85% SpaceX IPO招股書首度曝光