熱門資訊> 正文

SuperX(SUPX.US)發佈模塊化AI工廠解決方案 以預計6個月內的部署周期重塑AI基礎設施建設

2025-10-02 10:13

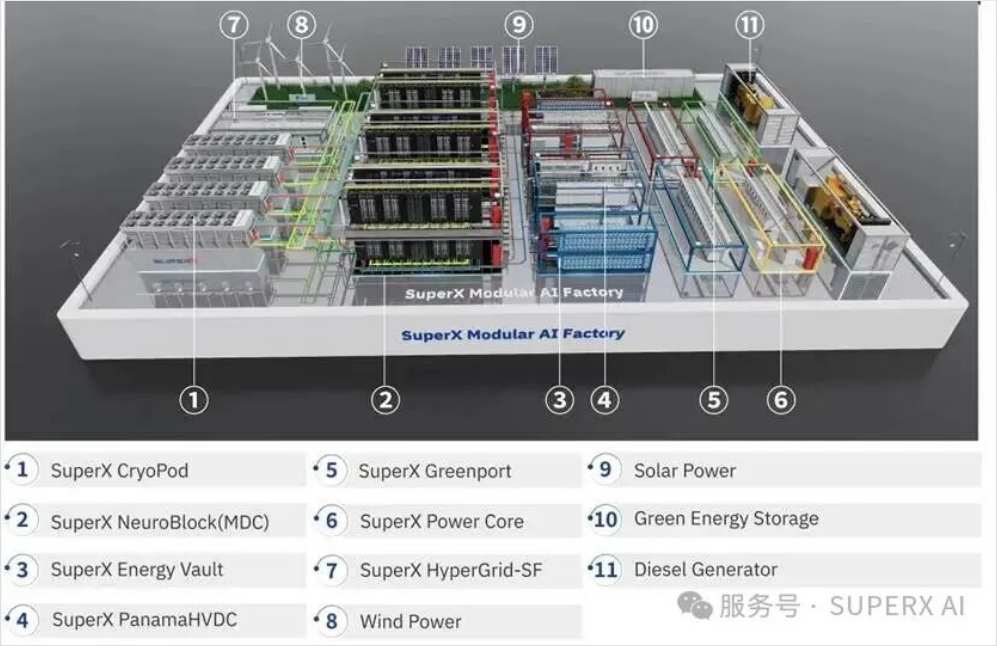

智通財經APP獲悉,10月1日,Super X AI Technology(SUPX.US)發佈其數據中心級解決方案——SuperX模塊化AI工廠。該解決方案旨在徹底解決傳統AI數據中心建設周期長、成本高、能耗大、擴展難的核心痛點,為AI時代的算力部署提供了一種顛覆式的創新解決方案。

SuperX模塊化AI工廠:全棧式解決方案

隨着全球企業競相部署大模型應用,對AI基礎設施的需求呈指數級增長。然而,傳統數據中心長達約18-24個月的建設周期已成為制約AI發展的關鍵瓶頸。SuperX模塊化AI工廠通過將算力、冷卻和電源系統在工廠進行預製化和深度集成,並通過減少樓宇建設工程量,預計可將現場交付和部署時間縮短至6個月以內,使客户能夠以最快速度搶佔市場先機。

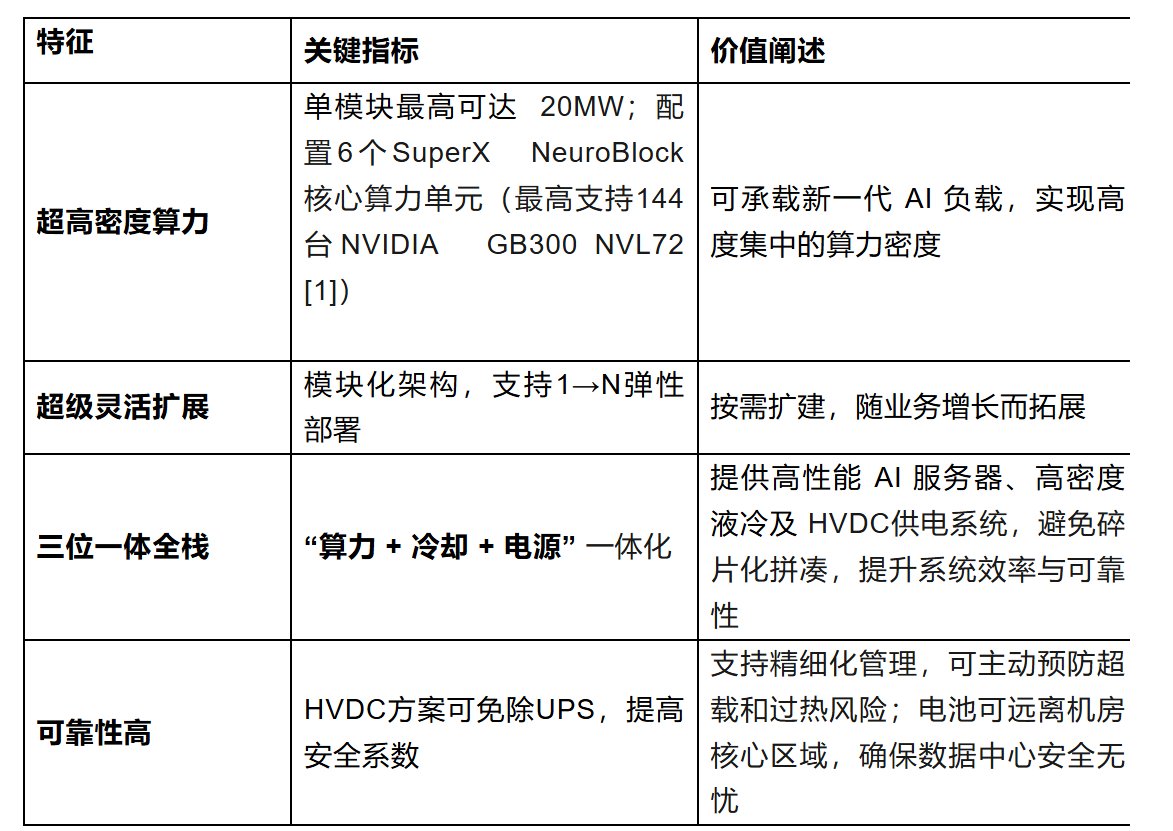

核心優勢一覽:

SuperX模塊化AI工廠,其創新點在於將算力、冷卻、電源高度集成,變「複雜定製」為「標準化產品」,實現即插即用。20MW的單模塊佔地預計僅需6,000㎡,可按需擴建,以「搭積木」的建設方案可無限擴張增加算力。

SuperX模塊化AI工廠:重新定義AI基礎設施的四大核心價值

SuperX的解決方案並非單一產品的革新,而是通過「四維價值模型」對AI基礎設施的交付、成本和效率標準進行了系統性重構:

超快交付:所有核心模塊,包括算力、冷卻和電源單元,均在工廠完成預製、集成與測試。現場只需進行快速拼裝,預計可將現場部署時間縮短至6個月內,讓AI算力近乎「即插即用」。

超高密度: 方案的核心算力單元 SuperX NeuroBlock最高支持24台NVIDIA GB300 NVL72,功率高達3.5MW,為傳統方案的7倍[2]。通過與高密度液冷和HVDC供電系統的深度耦合,實現了高度的算力密度,同算力密度下佔地面積大幅度減少,從而在更小的物理空間內釋放更澎湃的算力。

極致能效: 方案全面採用高壓直流(HVDC)供電技術,將端到端供電效率提升至98.5%以上,並結合先進的液冷技術,使整體PUE(電源使用效率)低至1.15,對比傳統風冷(PUE約1.5[3])方案總體能耗降低23%。

超級靈活: 「模塊化」是該方案的核心。客户可以根據業務需求,從單個模塊起步,未來按需進行「1到N」的無縫線性擴展,大大地降低了客户初期的資本開支(CAPEX),並能完美匹配AI業務快速迭代的特點。

SuperX向「標準定義者」的戰略升級

AI算力落地最重要的因素,就是部署的速度及長期能耗節省,傳統數據中心的建設模式較難匹配AI時代所需要的快速迭代需求,SuperX模塊化人工智能工廠旨在解決這一瓶頸,它能夠實現更快的部署和更節能的運營,SuperX相信這可以提升客户的投資回報率。SuperX模塊化AI工廠的發佈,標誌着SuperX將AI基礎設施從‘工程項目’轉變為‘標準化產品’,同時也標誌着SuperX向定義下一代AI工廠標準的解決方案提供商的戰略升級,致力於驅動傳統數據中心向AI工廠的全面轉型。

推薦文章

港股周報 | 中國大模型「春節檔」打響!智譜周漲超138%;鉅虧超230億!美團周內重挫超10%

一周財經日曆 | 港美股迎「春節+總統日」雙假期!萬億零售巨頭沃爾瑪將發財報

一周IPO | 賺錢效應持續火熱!年內24只上市新股「0」破發;「圖模融合第一股」海致科技首日飆漲逾242%

從軟件到房地產,美國多板塊陷入AI恐慌拋售潮

Meta計劃為智能眼鏡添加人臉識別技術

危機四伏,市場卻似乎毫不在意

美股機會日報 | 降息預期升溫!美國1月CPI年率創去年5月來新低;淨利、指引雙超預期!應用材料盤前漲超10%

財報前瞻 | 英偉達Q4財報放榜在即!高盛、瑞銀預計將大超預期,兩大關鍵催化將帶來意外驚喜?